免手持擴增實境測試

作者: 塾長 日期: 2015-01-04 18:04

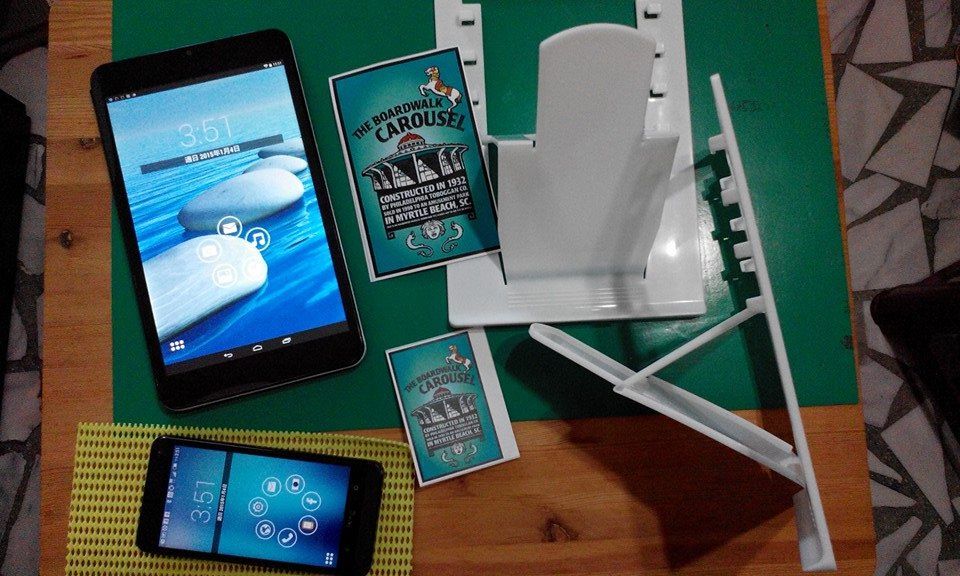

我想了有一陣子:如果擴增實境時都得手持使用,這樣有點可惜。趁連假最後一天來簡單測試比較,我利用手機、平板,大小張『Asbury Park』迴轉馬車 ,還有大創的平板架與WeDo老師送我的顯微觀察座。

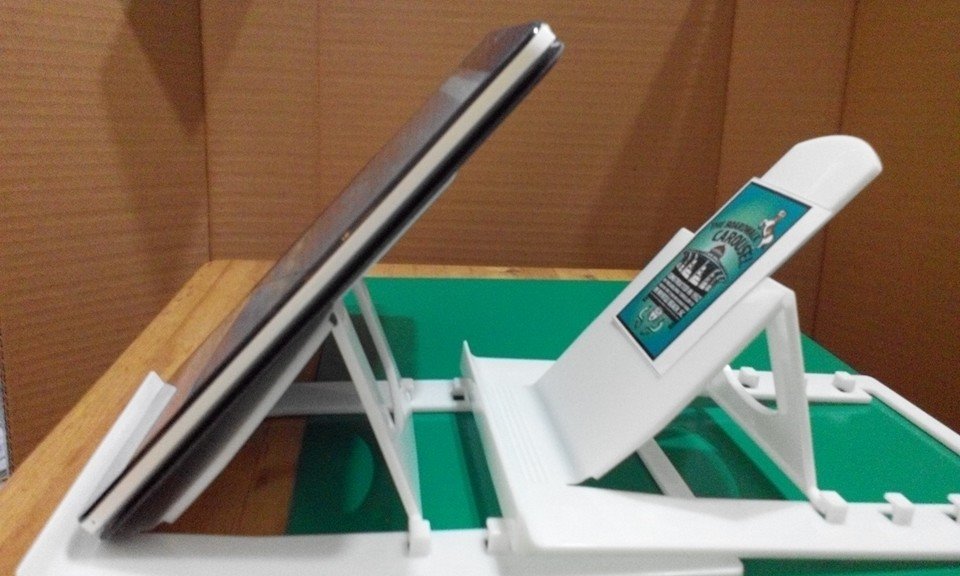

*斜放架,保持和教材垂直

保持鏡頭與內容物的垂直視角能展現最好的擴增實境辨識效果,我用兩個架子保持平行的斜角,再分別放上手機、平板,辨識大、小張圖案,架子可以輕鬆調整距離與微調角度,不過這裡的紙片日後若是換成書本,待辨識的位置可能就不會這麼好對準了。我再從兩個角度切入發想:看是移動平板鏡頭位置角度,或是讓書本可以輕鬆翻頁、移位。此外,立體書、摺紙書的概念都可以套用看看。

|  |

|  |

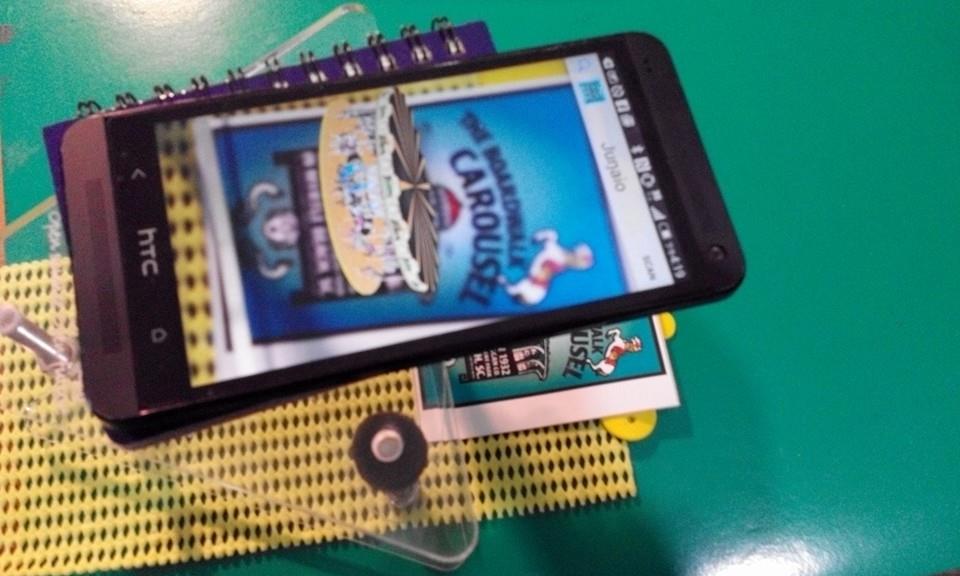

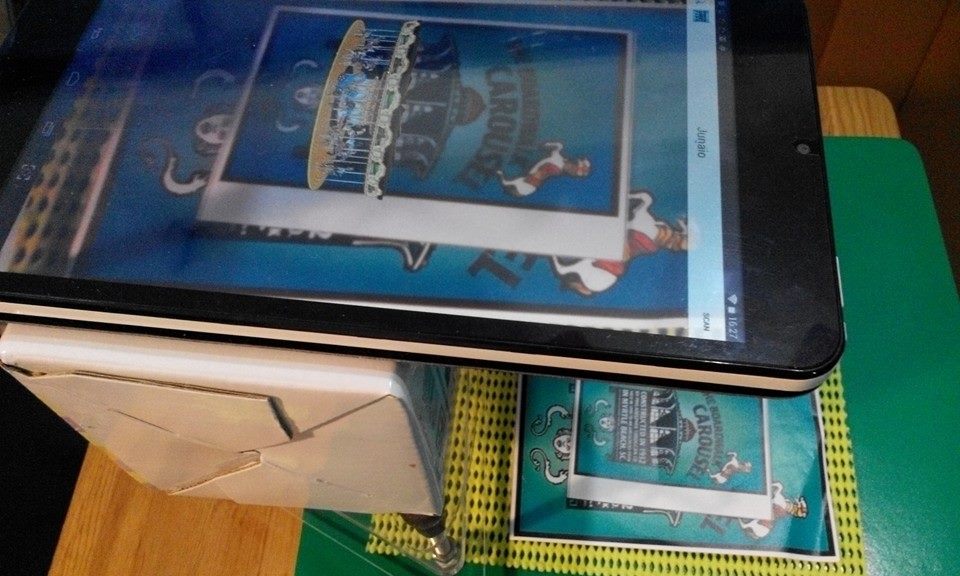

*垂直高放鏡頭拍攝

我用顯微觀察座放手機與平板,只需要將鏡頭伸出,下方來放辨識紙張即可,由於在Junaio進行辨識時已無法對焦、Zoom,尤其平板的鏡頭沒有廣角,需要再墊高一些才可以。試想一下:若將來學習內容(紙本、螢幕或桌面)上有一區塊提供AR,其他區塊還要能動手操弄、書寫與演算,如何在這麼多視覺區塊裡流暢切換與動手,真得好好設計一番!

|  |

|  |

*非桌面式應用

這裡沒做測試~擴增實境的辨識資料在牆面或實物,也可以讓孩子們自取移動,行動載具就利用掛架或夾子與腳架方式擺放。呵呵,上次有印象看到一種『義肢』戴身上用來放載具,效果也不錯!

*鏡頭的潛望鏡轉向

我也想過像『Osmo 』那樣做個潛望鏡,讓鏡頭視角與螢幕不會永遠只能垂直,或者,找合適且能被擴增實境App讀取的無線鏡頭,當然,乾脆把平板『拆』了看能不能拉線出來,就像原本WebCam和電腦螢幕的關係那樣,哈哈!

|  |

訂閱

訂閱 上一篇

上一篇 返回

返回 下一篇

下一篇

標籤:

標籤:

從Cospaces Edu改名為Delightex,我的八個期許… (2025-03-26 15:16)

與NotebookLM協作再開寫「生活中的程式設計」 (2025-02-02 13:29)

從中、韓看「教育元宇宙」產官學發展 (2024-04-05 15:24)

對於混合實境(Mixed Reality,MR)三項期許:「從屏看穿」、「情境感知」與「智能物件」 (2024-03-24 16:44)

TN400 ePBL首發~以COSPACES為例 (2024-02-14 15:09)

COSPACES「互動生態系」作品學習 (2024-02-13 10:28)

Tripo AI~AI生成3D模型 (2024-01-06 08:11)

「XR 實境教育創意大賞競賽」 (2024-01-05 19:21)

測試COSPACES方塊(Mergecube)三個想法 (2024-01-01 20:09)